简而言之:Puppeteer 允许您通过 Node.js 完全控制无头 Chrome 实例,使其成为抓取 JavaScript 渲染页面的首选工具。本指南将带您逐步了解安装、基于选择器的数据提取、无限滚动、表单登录、请求拦截、隐身插件、结构化数据导出以及 Docker 部署,助您从简单的测试脚本进阶到生产级别的爬虫。

网页抓取是指通过编程方式从网站中提取数据。当网站依赖客户端 JavaScript 来渲染内容时,简单的 HTTP 请求就无法胜任。您需要一个真正的浏览器,或者至少是一个能像浏览器一样工作的工具。这正是 Puppeteer 旨在解决的问题。

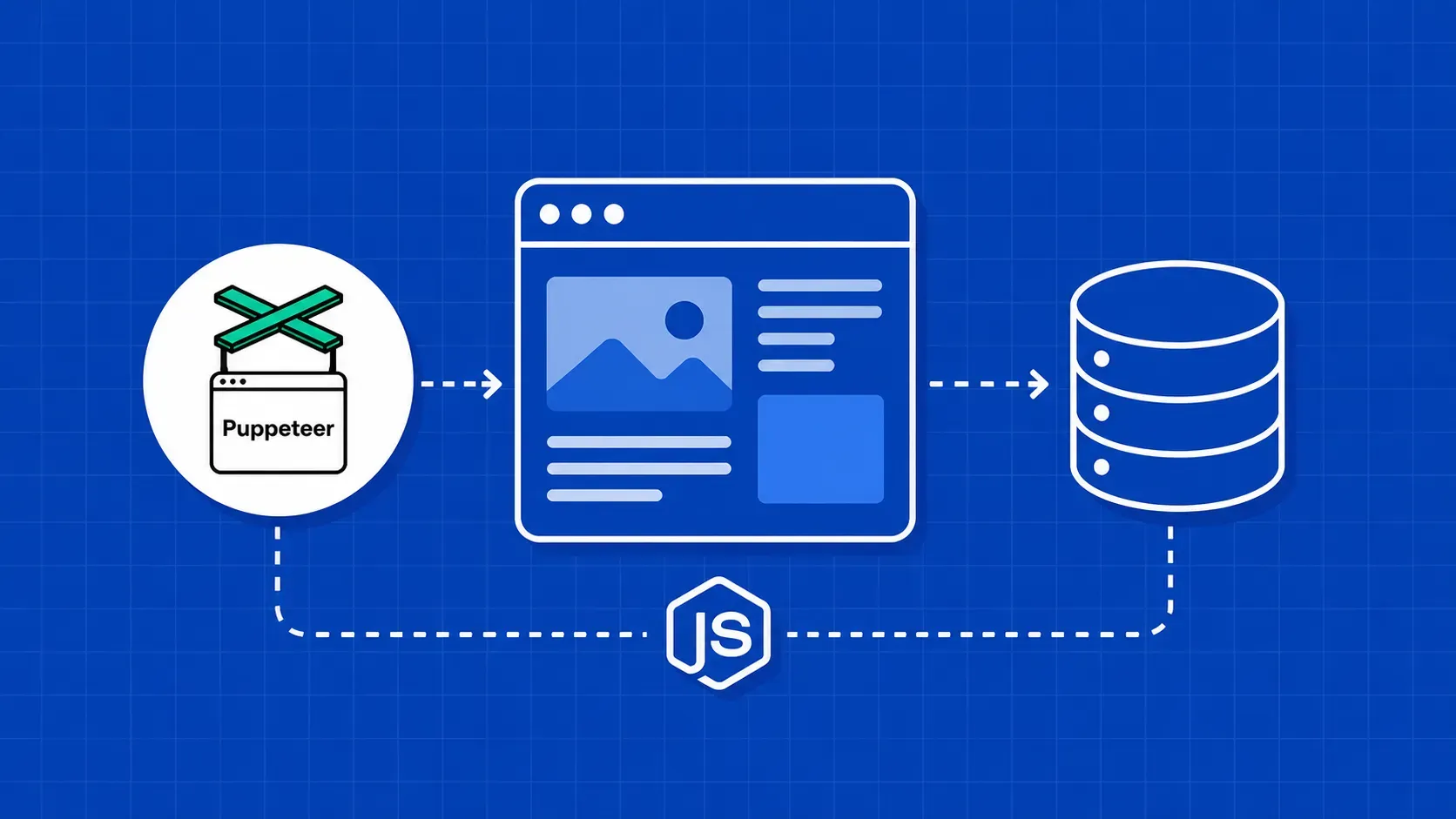

Puppeteer 是一个 Node.js 库,它通过 Chrome DevTools 协议驱动无头(或有头)Chrome 实例,让你能够利用 Puppeteer 和 Node.js 进行网页抓取。它可以点击按钮、填写表单、滚动页面,并在页面上下文中执行任意 JavaScript 代码,然后将结果返回给你的脚本。对于已经熟悉 JavaScript 的开发者来说,这是进入无头浏览器抓取 JavaScript 工作流的最自然途径之一。

在本教程中,您将学习如何从零开始搭建 Puppeteer 项目,从静态和动态页面中提取数据,处理分页和无限滚动,拦截隐藏的 API 调用,规避机器人检测,将结果导出为 JSON 和 CSV 格式,并将其整体部署到 Docker 容器中。 所有代码示例均针对 Node.js 18 或更高版本,且全篇均采用 Puppeteer v24 API 接口。无论您正在构建价格追踪器、潜在客户生成管道还是学术研究工具,本指南中的模式都将帮助您更快地投入生产环境。