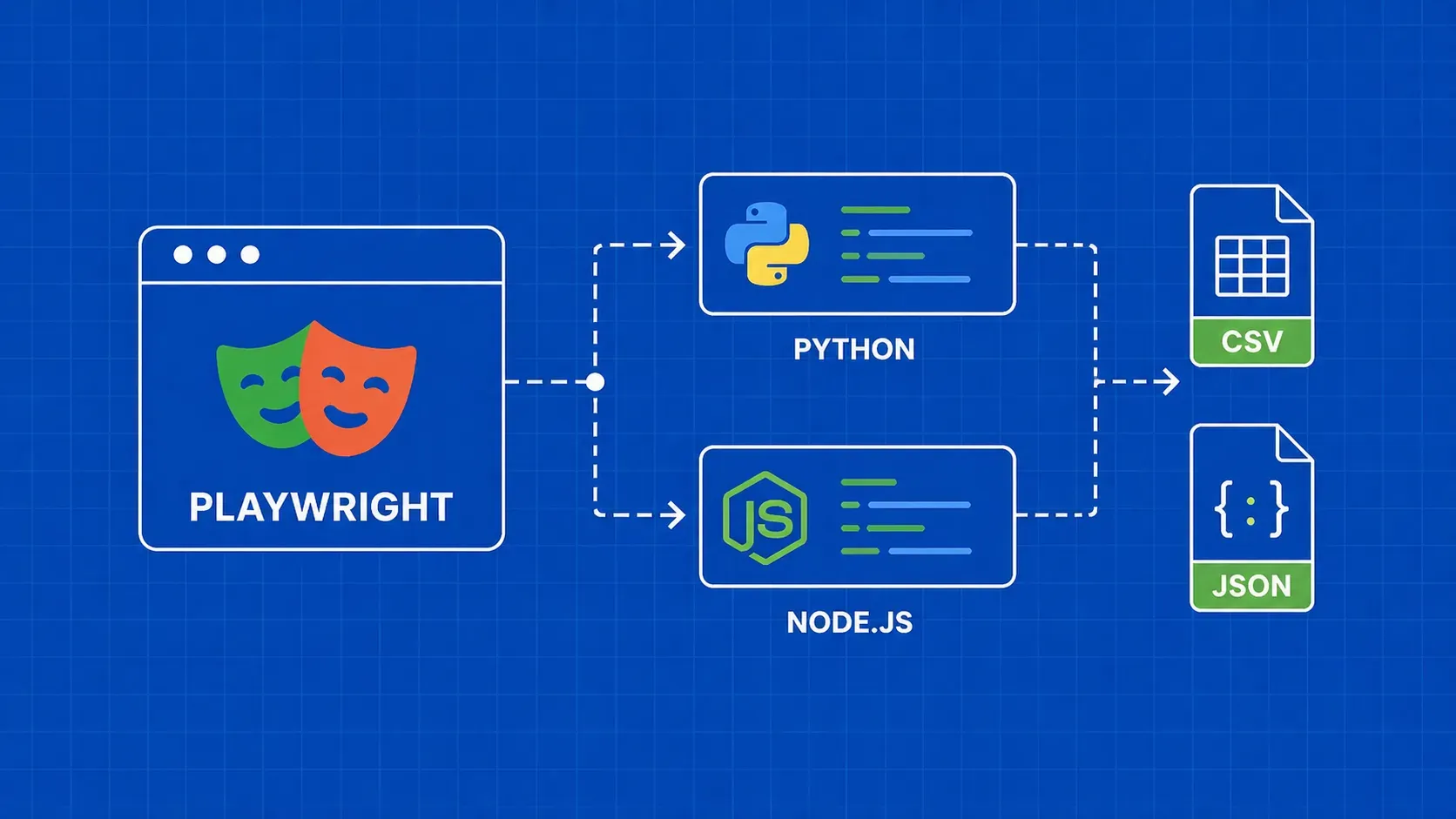

简而言之:Playwright 提供完整的浏览器自动化功能,用于抓取大量使用 JavaScript 的网站,并同时为 Python 和 Node.js 提供一流的支持。本指南将带您逐步了解安装、元素提取、代理配置、反检测、分页、图片下载以及将数据导出为 CSV 或 JSON 等内容,并附有两种语言的并列代码示例。

如果您曾尝试使用简单的 HTTP 客户端抓取现代单页应用程序,想必深有体会:返回的 HTML 只是一个空壳,而您想要的数据却封装在永远不会执行的 JavaScript 中。Playwright 网页抓取通过编程方式驱动真实浏览器(Chromium、Firefox 或 WebKit),让您的脚本能看到与人类访客完全一致的内容,从而解决了这一难题。

Playwright 是由微软维护的开源浏览器自动化框架。与旧版工具不同,它开箱即用,内置自动等待、网络拦截功能,并支持多种浏览器引擎。无论您使用 Python 还是 Node.js,其 API 接口几乎完全一致,因此您可以根据自己的技术栈选择任意一种语言。

本指南涵盖了从空终端到生产级 Playwright 爬虫脚本所需的一切内容:环境搭建、选择器、文本与图像提取、分页处理、请求拦截、代理配置、隐身技术、错误处理以及结构化数据导出。每项技术均包含 Python 和 Node.js 的示例代码。