简而言之:Node-unblocker 能将一个 Express 应用转变为一个可自由定制的 URL 前缀 HTTP 代理。本篇关于 Node-unblocker 的网络爬虫指南将详细介绍其安装步骤、请求与响应中间件的配置、实例轮换、在 Docker 或 Heroku 上的部署,以及何时应选择托管爬虫 API 作为更明智的解决方案。

如果你曾需要在 Node.js 爬虫前添加自定义代理跳转,你可能曾陷入“直接使用 SOCKS5 端点”与“部署真正的代理集群”之间的尴尬境地。Node-unblocker 的配置恰好填补了这一空白:它是一个轻量、可编程且支持 Express 挂载的代理,你可以通过 JavaScript 对其进行扩展。

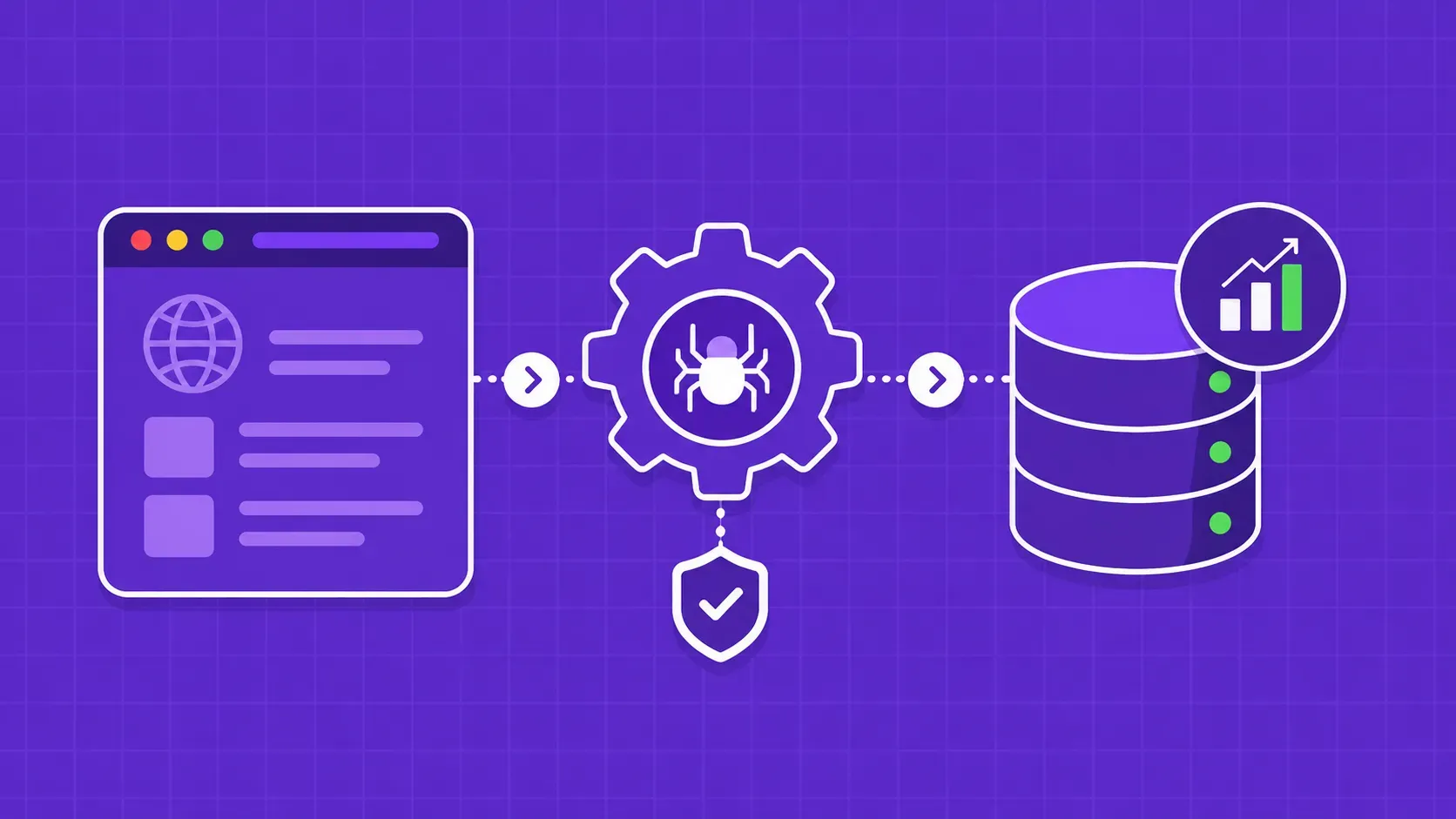

Node-unblocker 是一个具备 Express 兼容 API 的 Node.js 库。您只需启动一个实例,将其挂载到类似 /proxy/,随后任何附加该前缀的 URL 都会被抓取、重写并以流式传输的方式返回给调用方。由于所有操作都在您自己的 Node 进程中运行,您可以附加中间件来修改请求和响应,根据环境切换 IP 地址,并将业务逻辑直接嵌入代理本身。

本文面向希望构建可用的网络爬虫 Node Unblocker 代理的中级 Node.js 开发者,而非营销宣传。我们将涵盖安装、最简 Express 配置、配置对象、请求与响应中间件、轮询代理池模式、两种生产环境部署路径(Docker 和 Heroku)、法律与道德规范,以及该库不再有用的临界点。